Certaines applications de l’intelligence artificielle peuvent affecter directement les droits fondamentaux des personnes, comme le droit à la vie privée, la liberté d’expression, le droit à un traitement équitable ou la protection contre la discrimination.

Les systèmes de reconnaissance faciale, les dispositifs de surveillance automatisée ou encore les algorithmes utilisés pour la justice, le recrutement ou les politiques publiques peuvent reproduire et amplifier des biais systémiques, compromettant l’égalité de traitement et la dignité des individus. Le recours à des modèles opaques et difficilement contestables peut aussi porter atteinte au droit à un recours effectif.

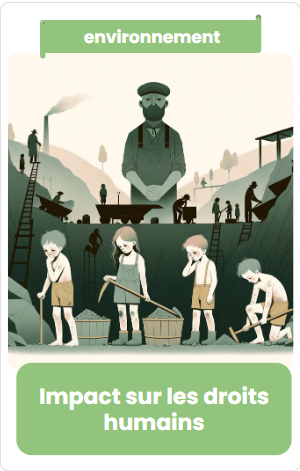

Un autre volet souvent ignoré concerne les conditions de travail des annotateurs de données, qui jouent un rôle essentiel dans l’entraînement des systèmes d’IA.

Ces travailleurs, majoritairement localisés dans des pays à faibles revenus, réalisent un travail minutieux et répétitif consistant à étiqueter manuellement des textes, images, sons ou vidéos. Ils sont exposés à des contenus sensibles (violence, discours haineux, etc.) dans des conditions parfois précaires, avec peu de reconnaissance et de protection sociale. Cela soulève des enjeux majeurs de justice sociale, de santé mentale et de dignité au travail, qui doivent être intégrés dans toute réflexion sur la dimension humaine de l’IA.